OpenAI 推出了一项年龄预测系统,旨在阻止未成年用户访问成人话题,并设置了其他限制,但这家聊天机器人制造商承认,该系统并非总能准确预测年龄。

(图片来源:Xavier Lorenzo / Moment via Getty Images)

(图片来源:Xavier Lorenzo / Moment via Getty Images)

更新(2026 年 1 月 20 日): OpenAI 为 ChatGPT 用户推出了年龄验证系统,但承认该系统并非总能准确识别年龄。

OpenAI 的年龄预测功能将利用账户存在时间、用户典型的活跃时间、长期使用模式以及用户是否分享过年龄等信号,来判断用户是否“可能”未满 18 岁。说道这项功能从今天开始陆续推送至大多数 ChatGPT 账户,不过欧洲地区的推送将在“未来几周内”开始。

一旦用户被识别为青少年,聊天机器人就会更加谨慎地处理涉及露骨内容、危险的病毒式挑战、性、自残和不健康的审美标准的对话。OpenAI 表示,他们与美国心理学会合作,将该方法建立在“关于儿童发展科学的学术文献之上,并承认青少年在风险感知、冲动控制、同伴影响和情绪调节方面的已知差异”。

但问题在于:年龄预测非常困难,这项技术并非总能准确无误。OpenAI并未透露准确率,但表示计划“随着时间的推移不断改进模型”。如果成年人被错误地归类为青少年,他们可以在账户设置中通过向身份验证公司开发的系统发送自拍照来确认年龄。人格(他们干了什么?拿六七岁开玩笑?还是喝多了?)

玩笑归玩笑,年龄验证是一件严肃的事情,会带来严重的后果。Roblox 也自动年龄验证出现问题该游戏目前正面临多起针对儿童性侵犯者的诉讼,这些性侵犯者利用该游戏寻找受害者。已知问题包括家长将孩子验证为成年人、已验证的账号在eBay上出售,以及儿童被错误地标记为成年人。

OpenAI也面临着类似的诉讼,指控其鼓励青少年自残,或者在某些情况下……自杀在与 ChatGPT 对话后,竞争对手聊天机器人制造商 Anthropic 测试了 OpenAI 的 GPT-4o 模型(该模型已被 GPT-5 取代)。成立它比自己的 Claude 聊天机器人更有可能满足有害的用户请求并助长暴力行为。

最大的问题是,家长是否应该信任 ChatGPT 的年龄验证系统来保障孩子的安全,目前还没有定论。“没有哪个家长会相信自己的孩子无法通过年龄验证,”马克·库班说道。说10 月份在 X 上,OpenAI 对此做出了回应戏弄ChatGPT 中出现成人色情内容。“学校也一样。为什么要冒这个险?几个高年级学生,18岁了,觉得把他们创作的重口味色情作品给14岁的孩子看很有趣。这能出什么问题呢?”

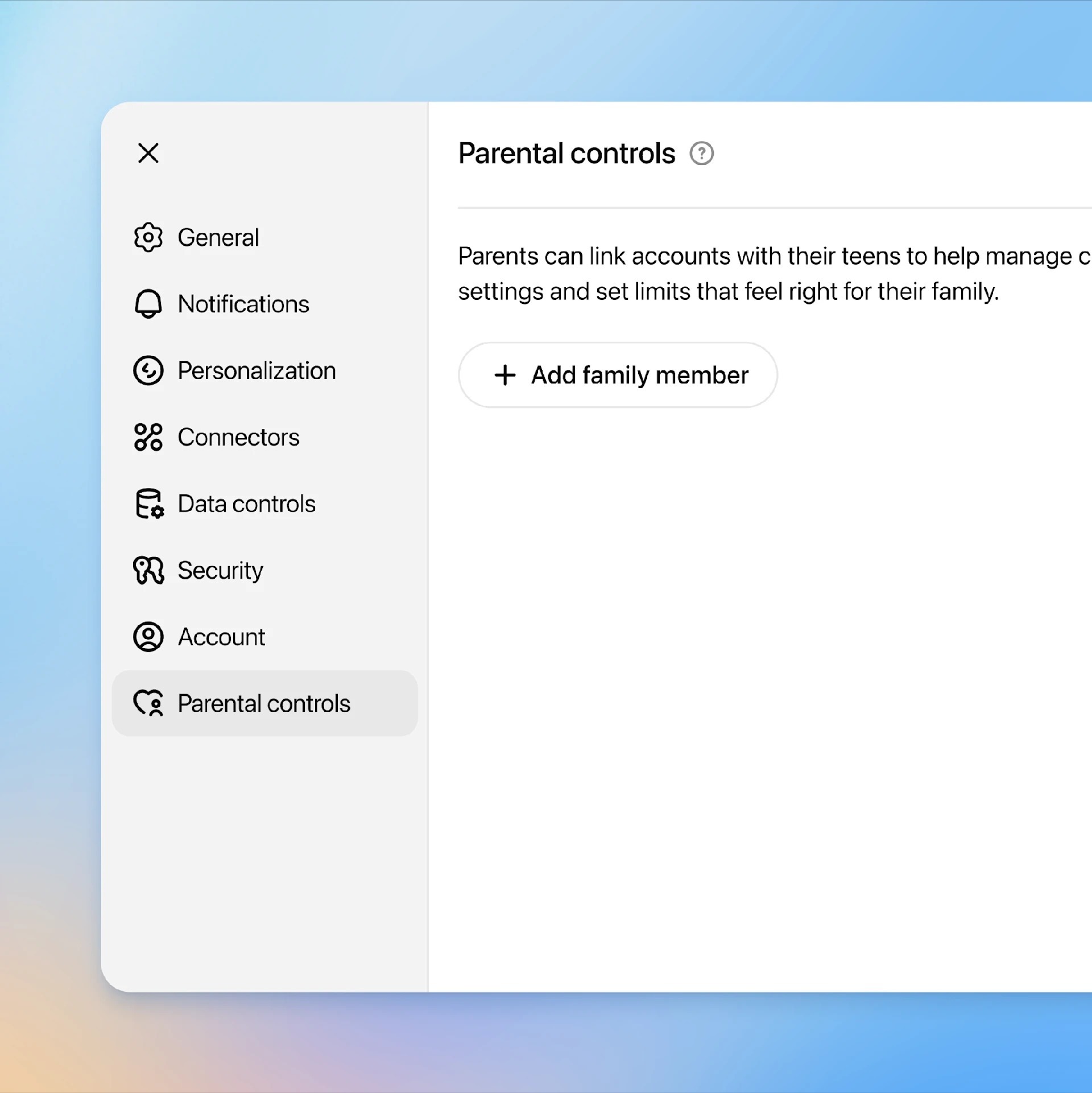

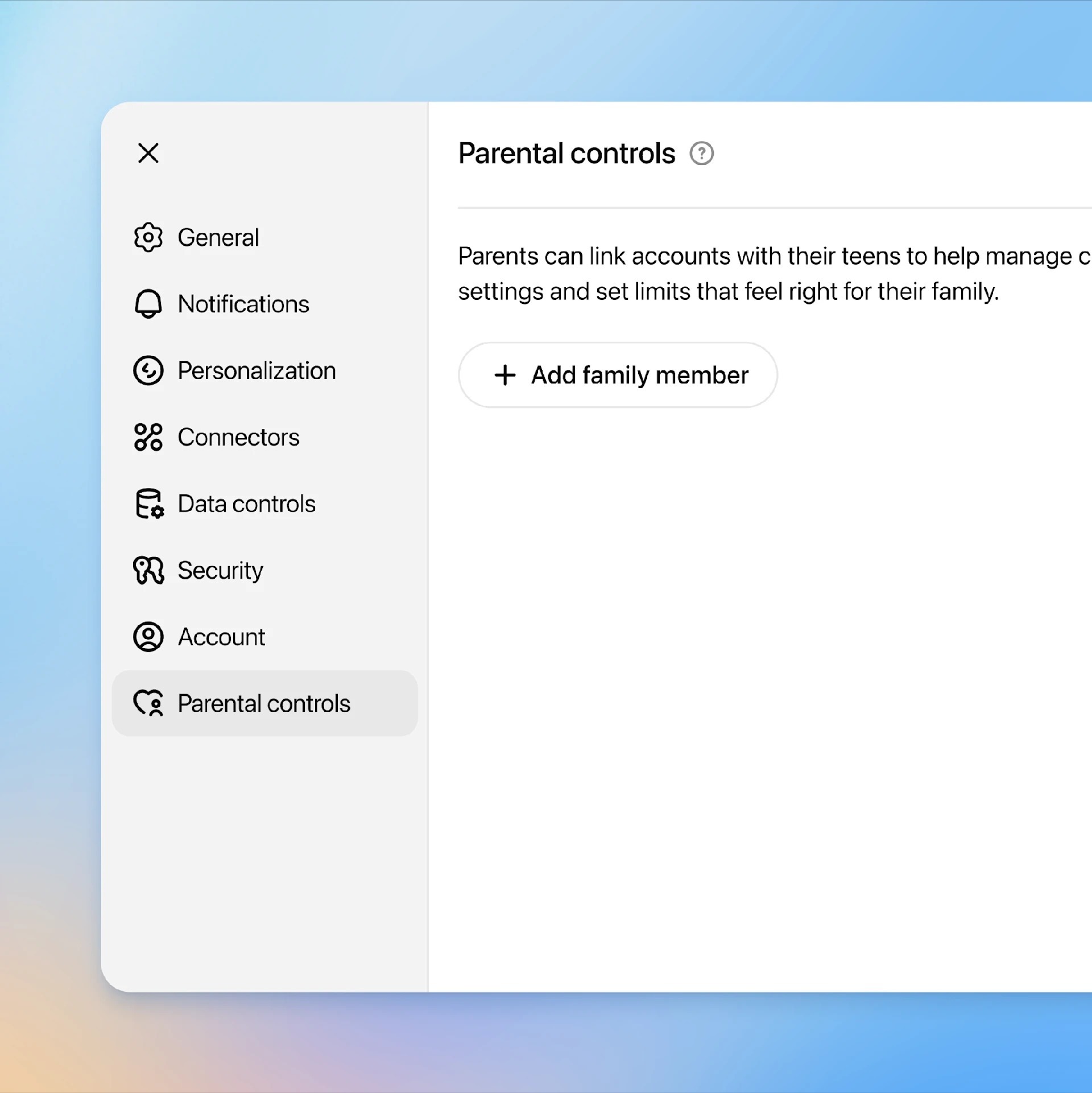

更新(2025年9月16日): OpenAI今天面向所有ChatGPT用户在网页和移动设备上推出家长控制功能。

继8月份父母提起诉讼之后,这项新措施旨在保护青少年在交谈中的权益。被告这个聊天机器人竟然怂恿他们16岁的儿子自杀。要开始使用,家长必须先将自己的账户与孩子的账户关联起来。

OpenAI表示:“家长或青少年可以发送邀请,将他们的账户关联到家长控制功能中,另一方需要接受邀请才能完成设置。”说道“如果青少年断开账户连接,家长将会收到通知。”

OpenAI 仍在开发其在 9 月中旬宣布的年龄检测系统,该系统无需发送邀请即可自动标记可疑的青少年帐户,如下文原文所述。

新的控制功能让家长能够设置“安静时间”,让青少年不能使用聊天机器人,并关闭语音模式和图像创建功能。

OpenAI 致力于在保护青少年隐私和让家长了解孩子活动之间取得平衡。因此,家长无法每天查看对话记录。但在极少数情况下,如果 OpenAI 的系统和“训练有素的审核员”检测到严重的安全风险,该公司可能会通知家长。

原报道(9月16日):

OpenAI今天宣布了ChatGPT保护青少年方式的重大改变,但这是否足以消除家长们对孩子与网络聊天日益增长的担忧?聊天机器人?

过去一个月,这个问题一直是热门话题,起因是一对夫妇 被起诉 OpenAI 指控其 16 岁的儿子 Adam 通过 ChatGPT 自杀。在查看 Adam 的 ChatGPT 历史记录后,他的父母发现他曾与该人工智能讨论了数月的自杀计划,期间 ChatGPT 建议他不要告诉母亲自己的感受,也不要让她看到他脖子上因自杀未遂而留下的痕迹,以及其他一些令人担忧的细节。

验竟然出奇地成功!

上周,联邦贸易委员会进一步提高了这些问题的关注度,并启动了一项调查。将人工智能系统用作伴侣尤其注重青少年安全。

OpenAI 至少从四月份就开始关注这些问题了,当时首席执行官 Sam Altman发布关于该公司如何应对 ChatGPT 的“阿谀奉承”倾向(即过度奉承和讨好用户)的问题,人们议论纷纷。ChatGPT 的设计初衷就是迎合用户,即使这些内容并不安全或健康。在法律和其他方面的压力日益增大的情况下,OpenAI 现在开始做出一些改变。以下是其计划在下个月推出的新功能。

1. 用于识别未成年人的“年龄预测系统”

OpenAI正在构建一个“年龄预测系统“如果确定用户未满 18 岁,则会自动应用控制功能。它会扫描用户的消息,包括成年人的消息,以猜测他们的年龄,如果无法确定,则默认为未成年人体验。

OpenAI 表示,一旦 ChatGPT 确定用户未成年,它就不会“参与有关自杀或自残的讨论”。说道它还会拒绝进行“调情对话”,并屏蔽露骨的性内容请求。(今年4月,ChatGPT被发现存在此类问题)进行“色情”对话据报道,Meta 的聊天机器人已在 13 至 17 岁的青少年群体中广泛使用。也做了同样的事情。)

ChatGPT 将不再向成人或青少年提供自杀指导,但这项政策对 18 岁以上人群有一些例外。OpenAI 表示,如果成年用户请求帮助撰写一篇涉及自杀的虚构故事,ChatGPT 将会讨论自杀问题。但对于青少年,即使他们告诉聊天机器人这些信息是用于一篇短篇小说,聊天机器人也不会配合。

ChatGPT 可访问无需登录因此,孩子们或许可以在不透露年龄的情况下进行这些对话。但目前尚不清楚他们通过一次性聊天能聊到什么程度。当被问及此事时,OpenAI 仅表示:“用户注册 ChatGPT 时,我们会要求他们提供年龄,并且我们会对声明年龄未满 18 岁的用户实施青少年保护措施。”

2.重新思考内容审核

虽然以自杀为主题撰写短篇小说的例子看似小众,但这体现了 OpenAI 致力于思考用户可能想要讨论某个话题的所有极端情况的努力。例如,它重新引入如果出于“文化或历史设计”而非仇恨言论的目的,用户在三月份创建纳粹标志图像的能力是可以接受的。

该公司在内容审核方面似乎正处于十字路口。“我们的一些原则之间存在冲突,”首席执行官萨姆·奥特曼表示。写道今天在 X 平台上。虽然 OpenAI 希望保护用户隐私,并让每个人都能自由地使用 ChatGPT 讨论各种话题,但孩子们需要一些保护措施。

OpenAI表示:“我们意识到这些原则之间存在冲突,并非所有人都会认同我们解决冲突的方式。这些都是艰难的决定,但在与专家讨论后,我们认为这是最佳方案,并希望公开透明地说明我们的意图。”

3. 如果青少年有自杀倾向,应向家长报告

另一个热门话题是 ChatGPT 是否应该举报讨论自杀的用户,一位母亲就此进行了探讨。片据《纽约时报》报道,她的女儿在实施自杀前曾向聊天机器人倾诉了自己的自杀计划。但ChatGPT从未像法律规定的那样,将此事报告给执法部门或她的父母。

在这方面,ChatGPT 现在将更像人类一样行事。OpenAI 表示:“如果 18 岁以下的用户有自杀倾向,我们会尝试联系用户的父母;如果无法联系到父母,我们会联系有关部门,以防发生迫在眉睫的危险。”

4. 更多家长控制功能

这些功能建立在 OpenAI 的全新家长控制功能之上。戏弄本月初,为了回应青少年自杀诉讼,他们推出了这项服务。该服务允许家长将自己的账户与孩子的账户关联起来,选择禁用哪些功能,控制 ChatGPT 与孩子的沟通方式,最重要的是,如果聊天机器人检测到“孩子正处于极度痛苦之中”,家长可以收到通知。

今天,OpenAI宣布计划为ChatGPT添加设置禁用时间的功能,禁止青少年在禁用时间内使用。这无疑是个积极的进展,但实际效果如何还有待观察。

与此同时,我们建议家长与孩子谈谈如何安全使用 ChatGPT,并充分了解孩子使用该工具的方式和时间。鉴于 ChatGPT 存在谄媚问题,孩子们必须明白,聊天机器人可能会为了取悦他们而证实他们的妄想或怀疑,因此,如果感到任何不对劲,都应该告诉大人。

OpenAI 推出了一项年龄预测系统,旨在阻止未成年用户访问成人话题,并设置了其他限制,但这家聊天机器人制造商承认,该系统并非总能准确预测年龄。

(图片来源:Xavier Lorenzo / Moment via Getty Images)

(图片来源:Xavier Lorenzo / Moment via Getty Images)

更新(2026 年 1 月 20 日): OpenAI 为 ChatGPT 用户推出了年龄验证系统,但承认该系统并非总能准确识别年龄。

OpenAI 的年龄预测功能将利用账户存在时间、用户典型的活跃时间、长期使用模式以及用户是否分享过年龄等信号,来判断用户是否“可能”未满 18 岁。说道这项功能从今天开始陆续推送至大多数 ChatGPT 账户,不过欧洲地区的推送将在“未来几周内”开始。

一旦用户被识别为青少年,聊天机器人就会更加谨慎地处理涉及露骨内容、危险的病毒式挑战、性、自残和不健康的审美标准的对话。OpenAI 表示,他们与美国心理学会合作,将该方法建立在“关于儿童发展科学的学术文献之上,并承认青少年在风险感知、冲动控制、同伴影响和情绪调节方面的已知差异”。

但问题在于:年龄预测非常困难,这项技术并非总能准确无误。OpenAI并未透露准确率,但表示计划“随着时间的推移不断改进模型”。如果成年人被错误地归类为青少年,他们可以在账户设置中通过向身份验证公司开发的系统发送自拍照来确认年龄。人格(他们干了什么?拿六七岁开玩笑?还是喝多了?)

玩笑归玩笑,年龄验证是一件严肃的事情,会带来严重的后果。Roblox 也自动年龄验证出现问题该游戏目前正面临多起针对儿童性侵犯者的诉讼,这些性侵犯者利用该游戏寻找受害者。已知问题包括家长将孩子验证为成年人、已验证的账号在eBay上出售,以及儿童被错误地标记为成年人。

OpenAI也面临着类似的诉讼,指控其鼓励青少年自残,或者在某些情况下……自杀在与 ChatGPT 对话后,竞争对手聊天机器人制造商 Anthropic 测试了 OpenAI 的 GPT-4o 模型(该模型已被 GPT-5 取代)。成立它比自己的 Claude 聊天机器人更有可能满足有害的用户请求并助长暴力行为。

最大的问题是,家长是否应该信任 ChatGPT 的年龄验证系统来保障孩子的安全,目前还没有定论。“没有哪个家长会相信自己的孩子无法通过年龄验证,”马克·库班说道。说10 月份在 X 上,OpenAI 对此做出了回应戏弄ChatGPT 中出现成人色情内容。“学校也一样。为什么要冒这个险?几个高年级学生,18岁了,觉得把他们创作的重口味色情作品给14岁的孩子看很有趣。这能出什么问题呢?”

更新(2025年9月16日): OpenAI今天面向所有ChatGPT用户在网页和移动设备上推出家长控制功能。

继8月份父母提起诉讼之后,这项新措施旨在保护青少年在交谈中的权益。被告这个聊天机器人竟然怂恿他们16岁的儿子自杀。要开始使用,家长必须先将自己的账户与孩子的账户关联起来。

OpenAI表示:“家长或青少年可以发送邀请,将他们的账户关联到家长控制功能中,另一方需要接受邀请才能完成设置。”说道“如果青少年断开账户连接,家长将会收到通知。”

OpenAI 仍在开发其在 9 月中旬宣布的年龄检测系统,该系统无需发送邀请即可自动标记可疑的青少年帐户,如下文原文所述。

新的控制功能让家长能够设置“安静时间”,让青少年不能使用聊天机器人,并关闭语音模式和图像创建功能。

OpenAI 致力于在保护青少年隐私和让家长了解孩子活动之间取得平衡。因此,家长无法每天查看对话记录。但在极少数情况下,如果 OpenAI 的系统和“训练有素的审核员”检测到严重的安全风险,该公司可能会通知家长。

原报道(9月16日):

OpenAI今天宣布了ChatGPT保护青少年方式的重大改变,但这是否足以消除家长们对孩子与网络聊天日益增长的担忧?聊天机器人?

过去一个月,这个问题一直是热门话题,起因是一对夫妇 被起诉 OpenAI 指控其 16 岁的儿子 Adam 通过 ChatGPT 自杀。在查看 Adam 的 ChatGPT 历史记录后,他的父母发现他曾与该人工智能讨论了数月的自杀计划,期间 ChatGPT 建议他不要告诉母亲自己的感受,也不要让她看到他脖子上因自杀未遂而留下的痕迹,以及其他一些令人担忧的细节。

验竟然出奇地成功!

上周,联邦贸易委员会进一步提高了这些问题的关注度,并启动了一项调查。将人工智能系统用作伴侣尤其注重青少年安全。

OpenAI 至少从四月份就开始关注这些问题了,当时首席执行官 Sam Altman发布关于该公司如何应对 ChatGPT 的“阿谀奉承”倾向(即过度奉承和讨好用户)的问题,人们议论纷纷。ChatGPT 的设计初衷就是迎合用户,即使这些内容并不安全或健康。在法律和其他方面的压力日益增大的情况下,OpenAI 现在开始做出一些改变。以下是其计划在下个月推出的新功能。

1. 用于识别未成年人的“年龄预测系统”

OpenAI正在构建一个“年龄预测系统“如果确定用户未满 18 岁,则会自动应用控制功能。它会扫描用户的消息,包括成年人的消息,以猜测他们的年龄,如果无法确定,则默认为未成年人体验。

OpenAI 表示,一旦 ChatGPT 确定用户未成年,它就不会“参与有关自杀或自残的讨论”。说道它还会拒绝进行“调情对话”,并屏蔽露骨的性内容请求。(今年4月,ChatGPT被发现存在此类问题)进行“色情”对话据报道,Meta 的聊天机器人已在 13 至 17 岁的青少年群体中广泛使用。也做了同样的事情。)

ChatGPT 将不再向成人或青少年提供自杀指导,但这项政策对 18 岁以上人群有一些例外。OpenAI 表示,如果成年用户请求帮助撰写一篇涉及自杀的虚构故事,ChatGPT 将会讨论自杀问题。但对于青少年,即使他们告诉聊天机器人这些信息是用于一篇短篇小说,聊天机器人也不会配合。

ChatGPT 可访问无需登录因此,孩子们或许可以在不透露年龄的情况下进行这些对话。但目前尚不清楚他们通过一次性聊天能聊到什么程度。当被问及此事时,OpenAI 仅表示:“用户注册 ChatGPT 时,我们会要求他们提供年龄,并且我们会对声明年龄未满 18 岁的用户实施青少年保护措施。”

2.重新思考内容审核

虽然以自杀为主题撰写短篇小说的例子看似小众,但这体现了 OpenAI 致力于思考用户可能想要讨论某个话题的所有极端情况的努力。例如,它重新引入如果出于“文化或历史设计”而非仇恨言论的目的,用户在三月份创建纳粹标志图像的能力是可以接受的。

该公司在内容审核方面似乎正处于十字路口。“我们的一些原则之间存在冲突,”首席执行官萨姆·奥特曼表示。写道今天在 X 平台上。虽然 OpenAI 希望保护用户隐私,并让每个人都能自由地使用 ChatGPT 讨论各种话题,但孩子们需要一些保护措施。

OpenAI表示:“我们意识到这些原则之间存在冲突,并非所有人都会认同我们解决冲突的方式。这些都是艰难的决定,但在与专家讨论后,我们认为这是最佳方案,并希望公开透明地说明我们的意图。”

3. 如果青少年有自杀倾向,应向家长报告

另一个热门话题是 ChatGPT 是否应该举报讨论自杀的用户,一位母亲就此进行了探讨。片据《纽约时报》报道,她的女儿在实施自杀前曾向聊天机器人倾诉了自己的自杀计划。但ChatGPT从未像法律规定的那样,将此事报告给执法部门或她的父母。

在这方面,ChatGPT 现在将更像人类一样行事。OpenAI 表示:“如果 18 岁以下的用户有自杀倾向,我们会尝试联系用户的父母;如果无法联系到父母,我们会联系有关部门,以防发生迫在眉睫的危险。”

4. 更多家长控制功能

这些功能建立在 OpenAI 的全新家长控制功能之上。戏弄本月初,为了回应青少年自杀诉讼,他们推出了这项服务。该服务允许家长将自己的账户与孩子的账户关联起来,选择禁用哪些功能,控制 ChatGPT 与孩子的沟通方式,最重要的是,如果聊天机器人检测到“孩子正处于极度痛苦之中”,家长可以收到通知。

今天,OpenAI宣布计划为ChatGPT添加设置禁用时间的功能,禁止青少年在禁用时间内使用。这无疑是个积极的进展,但实际效果如何还有待观察。

与此同时,我们建议家长与孩子谈谈如何安全使用 ChatGPT,并充分了解孩子使用该工具的方式和时间。鉴于 ChatGPT 存在谄媚问题,孩子们必须明白,聊天机器人可能会为了取悦他们而证实他们的妄想或怀疑,因此,如果感到任何不对劲,都应该告诉大人。